一種基于AI的虛擬數(shù)字人交互系統(tǒng)的制作方法

本發(fā)明涉及數(shù)據(jù)處理,特別是指一種基于ai的虛擬數(shù)字人交互系統(tǒng)。

背景技術(shù):

1、當(dāng)前,虛擬數(shù)字人交互系統(tǒng)在教育領(lǐng)域得到廣泛應(yīng)用,主要基于計(jì)算機(jī)圖形學(xué)、自然語言處理以及深度學(xué)習(xí)等技術(shù)構(gòu)建虛擬人物形象,實(shí)現(xiàn)智能交互,其中,虛擬數(shù)字人生成通常依賴于3d建模、動(dòng)作捕捉和語音合成技術(shù),通過建模工具構(gòu)建人物外觀,并借助渲染引擎提升真實(shí)感,在交互方面,自然語言處理技術(shù)使虛擬數(shù)字人能夠理解并回應(yīng)用戶輸入的文本或語音,情緒識別算法進(jìn)一步增強(qiáng)其互動(dòng)體驗(yàn),使其能根據(jù)用戶的情緒調(diào)整語調(diào)、表情甚至動(dòng)作。

2、現(xiàn)有的虛擬數(shù)字人雖然能夠識別文本或語音指令,但對于實(shí)時(shí)、多模態(tài)輸入的理解仍然存在局限,例如,在教育場景下,學(xué)生的語音、語氣、面部表情和身體動(dòng)作通常能傳遞出復(fù)雜的情緒和需求,現(xiàn)有系統(tǒng)往往僅依賴語音或文本輸入進(jìn)行響應(yīng),這種單一模態(tài)處理方式使得虛擬數(shù)字人在面對復(fù)雜交互場景時(shí)難以作出精準(zhǔn)判斷,可能無法精準(zhǔn)感知學(xué)生的注意力狀態(tài)或情緒變化,影響教學(xué)效果。

技術(shù)實(shí)現(xiàn)思路

1、本發(fā)明的目的在于提供一種基于ai的虛擬數(shù)字人交互系統(tǒng),旨在解決背景技術(shù)中所提到的問題。

2、為解決上述技術(shù)問題,本發(fā)明的技術(shù)方案如下:

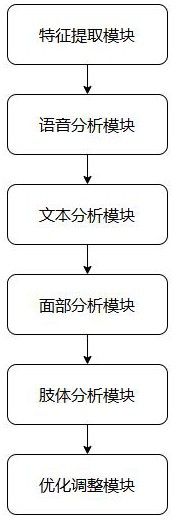

3、一種基于ai的虛擬數(shù)字人交互系統(tǒng),所述系統(tǒng)包括:

4、特征提取模塊,用于對預(yù)處理后的交互數(shù)據(jù)集進(jìn)行特征提取,得到用戶特征數(shù)據(jù)集;

5、語音分析模塊,用于根據(jù)用戶特征數(shù)據(jù)集,計(jì)算音頻變化率和語速穩(wěn)定性,分析用戶的語音情緒類型,得到語音情緒數(shù)據(jù);

6、文本分析模塊,用于根據(jù)用戶特征數(shù)據(jù)集,計(jì)算句法復(fù)雜度并統(tǒng)計(jì)情感詞數(shù)量,分析用戶的文本情緒類型,得到文本情緒數(shù)據(jù);

7、面部分析模塊,用于根據(jù)用戶特征數(shù)據(jù)集,計(jì)算面部表情對稱度,分析用戶的面部情緒類型,得到面部情緒數(shù)據(jù);

8、肢體分析模塊,用于根據(jù)用戶特征數(shù)據(jù)集,計(jì)算身體穩(wěn)定性并識別視覺停留區(qū)域,分析用戶的注意力狀態(tài),得到注意力狀態(tài)數(shù)據(jù);

9、優(yōu)化調(diào)整模塊,用于根據(jù)語音情緒數(shù)據(jù),調(diào)整虛擬數(shù)字人的音調(diào)和語速;根據(jù)文本情緒數(shù)據(jù),優(yōu)化虛擬數(shù)字人文本中的句式復(fù)雜度和情感詞;根據(jù)面部情緒數(shù)據(jù),調(diào)整虛擬數(shù)字人的眼睛、眉毛和嘴角的變化;根據(jù)注意力狀態(tài)數(shù)據(jù),調(diào)整信息展示順序和視覺焦點(diǎn)引導(dǎo)。

10、進(jìn)一步的,所述特征提取模塊包括:

11、語音特征提取單元,用于根據(jù)交互數(shù)據(jù)集,計(jì)算語音數(shù)據(jù)的基頻曲線,得到語音基頻特征,并對其進(jìn)行頻域轉(zhuǎn)換,得到語音時(shí)頻特征,根據(jù)語音時(shí)頻特征計(jì)算語音數(shù)據(jù)的能量值,得到語音能量特征;

12、文本特征提取單元,用于根據(jù)交互數(shù)據(jù)集,對文本數(shù)據(jù)進(jìn)行結(jié)構(gòu)分析,提取文本數(shù)據(jù)的基本結(jié)構(gòu)信息,得到文本結(jié)構(gòu)特征,并根據(jù)其提取文本數(shù)據(jù)中的情感詞,得到文本情感詞特征;

13、面部特征提取單元,用于根據(jù)交互數(shù)據(jù)集,提取眼睛、眉毛、嘴角和面部輪廓的位置信息,識別面部數(shù)據(jù)的關(guān)鍵點(diǎn),得到面部關(guān)鍵點(diǎn)特征,通過分析相鄰時(shí)間幀之間的關(guān)鍵點(diǎn)位移,得到表情變化特征;

14、肢體特征提取單元,用于根據(jù)交互數(shù)據(jù)集,提取頭部、手臂、軀干和腿部的位置信息,得到肢體關(guān)節(jié)點(diǎn)特征,并根據(jù)其繪制用戶動(dòng)作的軌跡曲線,分析用戶的運(yùn)動(dòng)模式,得到肢體動(dòng)作軌跡特征。

15、進(jìn)一步的,所述語音分析模塊包括:

16、音頻變化計(jì)算單元,用于根據(jù)語音基頻特征,分析語音基頻的變化趨勢,計(jì)算語音基頻的音頻變化率,得到語音基頻變化數(shù)據(jù);

17、時(shí)間序列單元,用于根據(jù)語音能量特征,計(jì)算語音數(shù)據(jù)在固定時(shí)間窗口內(nèi)的能量值,得到語音能量時(shí)間序列數(shù)據(jù);

18、能量波動(dòng)計(jì)算單元,用于根據(jù)語音能量時(shí)間序列數(shù)據(jù),計(jì)算連續(xù)時(shí)間窗口之間的能量變化率,得到語音能量波動(dòng)數(shù)據(jù);

19、語速穩(wěn)定性分析單元,用于根據(jù)語音能量波動(dòng)數(shù)據(jù),計(jì)算語音數(shù)據(jù)的能量波動(dòng)標(biāo)準(zhǔn)差,分析能量值隨時(shí)間的波動(dòng)程度,得到語速穩(wěn)定性數(shù)據(jù);

20、語音情緒判斷單元,用于根據(jù)語音基頻變化數(shù)據(jù)和語速穩(wěn)定性數(shù)據(jù),判斷用戶的語音情緒類型,得到語音情緒數(shù)據(jù)。

21、進(jìn)一步的,所述語速穩(wěn)定性分析單元包括:

22、標(biāo)準(zhǔn)差計(jì)算單元,用于根據(jù)語音能量波動(dòng)數(shù)據(jù),計(jì)算語音數(shù)據(jù)的能量波動(dòng)均值,并根據(jù)能量波動(dòng)均值計(jì)算語音數(shù)據(jù)的標(biāo)準(zhǔn)差,得到語音能量標(biāo)準(zhǔn)差數(shù)據(jù);

23、歸一化處理單元,用于對語音能量標(biāo)準(zhǔn)差數(shù)據(jù)進(jìn)行歸一化處理,得到歸一化語速穩(wěn)定性數(shù)據(jù);

24、語速評估單元,用于根據(jù)歸一化語速穩(wěn)定性數(shù)據(jù),判斷用戶的語速穩(wěn)定性,當(dāng)歸一化語速穩(wěn)定性數(shù)據(jù)趨向1時(shí),則語速趨向穩(wěn)定;當(dāng)歸一化語速穩(wěn)定性數(shù)據(jù)趨向0時(shí),則語速趨向不穩(wěn)定。

25、進(jìn)一步的,所述文本分析模塊包括:

26、文本句法分析單元,用于根據(jù)文本結(jié)構(gòu)特征,對文本數(shù)據(jù)進(jìn)行句法分析,計(jì)算句法復(fù)雜度,得到文本句法數(shù)據(jù);

27、文本情感詞分析單元,用于根據(jù)文本情感詞特征,統(tǒng)計(jì)情感詞在文本數(shù)據(jù)中的數(shù)量,并計(jì)算情感詞頻,得到文本情感詞數(shù)據(jù);

28、文本情緒偏向度計(jì)算單元,用于根據(jù)文本句法數(shù)據(jù)和文本情感詞數(shù)據(jù),分析文本數(shù)據(jù)的情緒傾向,計(jì)算文本情緒偏向度,得到文本情緒偏向數(shù)據(jù);

29、文本情緒判斷單元,用于根據(jù)文本情緒偏向數(shù)據(jù),判斷用戶的文本情緒類型,得到文本情緒數(shù)據(jù)。

30、進(jìn)一步的,所述文本情緒偏向度計(jì)算單元包括:

31、情緒得分計(jì)算單元,用于根據(jù)文本情感詞數(shù)據(jù)和預(yù)設(shè)情緒詞典,計(jì)算情感詞的情緒得分;

32、情感詞權(quán)重計(jì)算單元,用于根據(jù)情緒得分,確定情感詞在文本數(shù)據(jù)中的文本權(quán)重;

33、句義一致性計(jì)算單元,用于根據(jù)文本句法數(shù)據(jù),確定情感詞在句子中的句子權(quán)重,并根據(jù)其計(jì)算情感詞在句子中的句義一致性;

34、文本情緒偏向度計(jì)算公式單元,用于根據(jù)句義一致性,計(jì)算文本情緒偏向度,文本情緒偏向度的計(jì)算公式為:

35、,

36、其中,為文本情緒偏向度,為第個(gè)情感詞的文本權(quán)重,為第個(gè)情感詞的情緒得分,為情感詞的總數(shù),為情感詞的索引,為文本數(shù)據(jù)中詞語的總數(shù)量,為文本數(shù)據(jù)中包含主語的句子數(shù)量,為文本數(shù)據(jù)中句子的總數(shù)量,為情感詞在文本數(shù)據(jù)中的占比,為句法復(fù)雜度,為第個(gè)情感詞在句子中的句義一致性,和為系數(shù)。

37、進(jìn)一步的,所述面部分析模塊包括:

38、面部關(guān)鍵點(diǎn)位置單元,用于根據(jù)面部關(guān)鍵點(diǎn)特征,確定眼睛、眉毛、嘴角的相對位置,得到面部關(guān)鍵點(diǎn)位置數(shù)據(jù);

39、面部表情變化單元,用于根據(jù)面部關(guān)鍵點(diǎn)位置數(shù)據(jù)和表情變化特征,計(jì)算相鄰時(shí)間幀之間的關(guān)鍵點(diǎn)偏移量,分析面部表情變化趨勢,得到面部表情動(dòng)態(tài)數(shù)據(jù);

40、面部表情對稱計(jì)算單元,用于根據(jù)面部表情動(dòng)態(tài)數(shù)據(jù),計(jì)算面部左右對稱性指數(shù),分析面部表情的穩(wěn)定程度,得到面部表情對稱性數(shù)據(jù);

41、面部情緒判斷單元,用于根據(jù)面部對稱性數(shù)據(jù),判斷用戶的面部情緒類型,得到面部情緒數(shù)據(jù)。

42、進(jìn)一步的,所述肢體分析模塊包括:

43、身體穩(wěn)定性計(jì)算單元,用于根據(jù)肢體動(dòng)作軌跡特征,分析用戶的動(dòng)作軌跡,計(jì)算單位時(shí)間內(nèi)的動(dòng)作頻率,得到身體穩(wěn)定性數(shù)據(jù);

44、視覺關(guān)注分析單元,用于根據(jù)頭部位置和眼睛方向,識別用戶的視覺停留區(qū)域,得到視覺關(guān)注數(shù)據(jù);

45、注意力狀態(tài)判斷單元,用于根據(jù)身體穩(wěn)定性數(shù)據(jù)和視覺關(guān)注數(shù)據(jù),判斷用戶的注意力狀態(tài),得到注意力狀態(tài)數(shù)據(jù)。

46、進(jìn)一步的,所述優(yōu)化調(diào)整模塊包括:

47、語音基頻調(diào)整單元,用于根據(jù)語音情緒數(shù)據(jù),提高虛擬數(shù)字人的語音基頻的上限,使語音數(shù)據(jù)更加高昂;

48、語速音調(diào)調(diào)整單元,用于根據(jù)語音情緒數(shù)據(jù),動(dòng)態(tài)優(yōu)化虛擬數(shù)字人的語速和音調(diào),使語音數(shù)據(jù)更加流暢;

49、句法復(fù)雜度調(diào)整單元,用于根據(jù)文本情緒數(shù)據(jù),優(yōu)化虛擬數(shù)字人文本中的句法復(fù)雜度,使其符合用戶的理解能力和情緒狀態(tài);

50、情感詞頻調(diào)整單元,用于根據(jù)文本情緒數(shù)據(jù),調(diào)整虛擬數(shù)字人文本中的情感詞使用頻率,增強(qiáng)用戶的情緒共鳴。

51、進(jìn)一步的,所述優(yōu)化調(diào)整模塊還包括:

52、眨眼頻率調(diào)整單元,用于根據(jù)面部情緒數(shù)據(jù),優(yōu)化虛擬數(shù)字人的眨眼頻率,使虛擬數(shù)字人表現(xiàn)專注狀態(tài);

53、嘴角眉毛調(diào)整單元,用于根據(jù)面部情緒數(shù)據(jù),優(yōu)化虛擬數(shù)字人的嘴角曲率和眉毛角度,使其符合用戶的情緒狀態(tài);

54、信息呈現(xiàn)順序調(diào)整單元,用于根據(jù)注意力狀態(tài)數(shù)據(jù),調(diào)整虛擬數(shù)字人的信息呈現(xiàn)順序,使其符合用戶的注意力集中狀態(tài);

55、視覺引導(dǎo)調(diào)整單元,用于根據(jù)注意力狀態(tài)數(shù)據(jù),調(diào)整虛擬數(shù)字人的視線方向和頭部動(dòng)作,使其符合用戶的視覺焦點(diǎn)。

56、本發(fā)明的上述方案至少包括以下有益效果:

57、本發(fā)明通過計(jì)算音頻變化率和語速穩(wěn)定性,分析用戶的語音情緒類型,從而得到語音情緒數(shù)據(jù),能夠通過量化計(jì)算方法來精確判斷用戶當(dāng)前的語音情緒狀態(tài),不僅關(guān)注語音內(nèi)容的文本信息,還能夠結(jié)合語音的韻律特征進(jìn)行情緒判斷,通過結(jié)合多個(gè)語音特征進(jìn)行分析,能夠提供比單一語音情感識別方法更準(zhǔn)確的判斷,提高虛擬數(shù)字人與用戶的情感共鳴,分析結(jié)果可作為輸入數(shù)據(jù),供優(yōu)化調(diào)整模塊使用,使交互更加自然流暢。

58、本發(fā)明通過計(jì)算句法復(fù)雜度和情感詞數(shù)量,分析用戶的文本情緒類型,得到文本情緒數(shù)據(jù),引入了更復(fù)雜的文本分析方法,如句法結(jié)構(gòu)分析和情感詞頻統(tǒng)計(jì),以提高文本情緒識別的準(zhǔn)確性,當(dāng)用戶輸入的文本包含較多的復(fù)雜句式且負(fù)面情感詞較多時(shí),系統(tǒng)可以判斷用戶可能處于焦慮或不安狀態(tài);而使用較多簡短句且包含正面情感詞的文本可能代表高興或興奮情緒,不僅能夠提高文本情緒分析的精度,還可以結(jié)合語音分析模塊的結(jié)果,進(jìn)一步增強(qiáng)多模態(tài)情緒判斷的可靠性。

59、本發(fā)明通過計(jì)算面部表情對稱度,分析用戶的面部情緒類型,得到面部情緒數(shù)據(jù),增加了對面部關(guān)鍵點(diǎn)的動(dòng)態(tài)跟蹤,能夠更精準(zhǔn)地捕捉用戶情緒的變化,通過分析相鄰時(shí)間幀之間的關(guān)鍵點(diǎn)位移,可以檢測微笑、皺眉、驚訝等表情變化,從而推測用戶的情緒狀態(tài),并且引入了面部對稱性分析,以評估表情的穩(wěn)定性,這種精細(xì)化的表情分析方法能夠顯著提升虛擬數(shù)字人對用戶情緒的感知能力,從而做出更符合用戶心理狀態(tài)的交互反饋。

60、本發(fā)明通過計(jì)算身體穩(wěn)定性并識別視覺停留區(qū)域,分析用戶的注意力狀態(tài),得到注意力狀態(tài)數(shù)據(jù),通過追蹤用戶的頭部、手臂、腿部等關(guān)鍵關(guān)節(jié)的運(yùn)動(dòng)軌跡,計(jì)算肢體穩(wěn)定性,并結(jié)合頭部朝向和視覺停留區(qū)域的信息,推測用戶的專注程度,當(dāng)用戶的頭部頻繁移動(dòng)且視覺停留時(shí)間較短,則可能意味著注意力不集中;當(dāng)用戶的視線固定在屏幕上的時(shí)間較長,則可能代表高度專注,使虛擬數(shù)字人能夠?qū)τ脩舻淖⒁饬顟B(tài)進(jìn)行精準(zhǔn)判斷,從而在教學(xué)或培訓(xùn)等場景中提供更個(gè)性化的內(nèi)容推送,提高用戶的學(xué)習(xí)效率和交互體驗(yàn)。

61、本發(fā)明通過語音情緒數(shù)據(jù)、文本情緒數(shù)據(jù)、面部情緒數(shù)據(jù)和注意力狀態(tài)數(shù)據(jù),對虛擬數(shù)字人的語音、文本、表情和視覺引導(dǎo)方式進(jìn)行動(dòng)態(tài)調(diào)整,能夠根據(jù)用戶的實(shí)時(shí)狀態(tài),調(diào)整虛擬數(shù)字人的交互表現(xiàn),使其更具個(gè)性化和情感共鳴,在語音方面,能夠動(dòng)態(tài)調(diào)整虛擬數(shù)字人的語速和音調(diào),使其符合用戶的情緒狀態(tài);在文本方面,可以優(yōu)化句式復(fù)雜度,使文本表達(dá)更自然;在視覺表現(xiàn)方面,能夠調(diào)整虛擬數(shù)字人的眼神、嘴角曲率等,以更真實(shí)地模擬人類情緒反應(yīng),相比于現(xiàn)有技術(shù)中基于預(yù)設(shè)規(guī)則的簡單交互方式,該功能能夠顯著提升虛擬數(shù)字人與用戶之間的互動(dòng)自然度。

- 還沒有人留言評論。精彩留言會(huì)獲得點(diǎn)贊!