基于一維殘差網(wǎng)絡(luò)的多源信號刀具磨損量預(yù)測方法及系統(tǒng)

本發(fā)明涉及工業(yè)監(jiān)測,特別涉及基于一維殘差網(wǎng)絡(luò)的多源信號刀具磨損量預(yù)測方法及系統(tǒng)。

背景技術(shù):

1、高精密數(shù)控機床是先進制造業(yè)發(fā)展中必不可少的重要裝備之一,數(shù)控機床的刀具在切削加工過程與零件劇烈摩擦,不可避免地會產(chǎn)生磨損,刀具的磨損狀態(tài)直接影響了零件表面加工質(zhì)量,一旦出現(xiàn)刀具嚴重磨損,將導(dǎo)致加工零件不合格甚至報廢,對企業(yè)造成重大損失,因此十分有必要對加工過程中數(shù)控機床的刀具磨損狀態(tài)進行實時監(jiān)測。目前的監(jiān)測手段主要是通過使用加工過程產(chǎn)生的振動信號預(yù)測刀具磨損值。這種方法信號源單一,在復(fù)雜切削環(huán)境下易受噪聲和環(huán)境擾動等的影響,具有較大局限性和不準確性;同時,采集的數(shù)據(jù)中大部分是刀具正常磨損狀態(tài)的數(shù)據(jù),嚴重磨損的數(shù)據(jù)稀少。這種單一信號下的不平衡數(shù)據(jù)造成預(yù)測精度不足,不利于準確預(yù)測刀具磨損值。隨時深度學(xué)習(xí)理論的不斷發(fā)展,多信號融合的方法在特征提取和模式識別上表現(xiàn)出明顯優(yōu)勢,對不平衡數(shù)據(jù)集不同工況下的刀具磨損預(yù)測具有較大應(yīng)用潛力。

技術(shù)實現(xiàn)思路

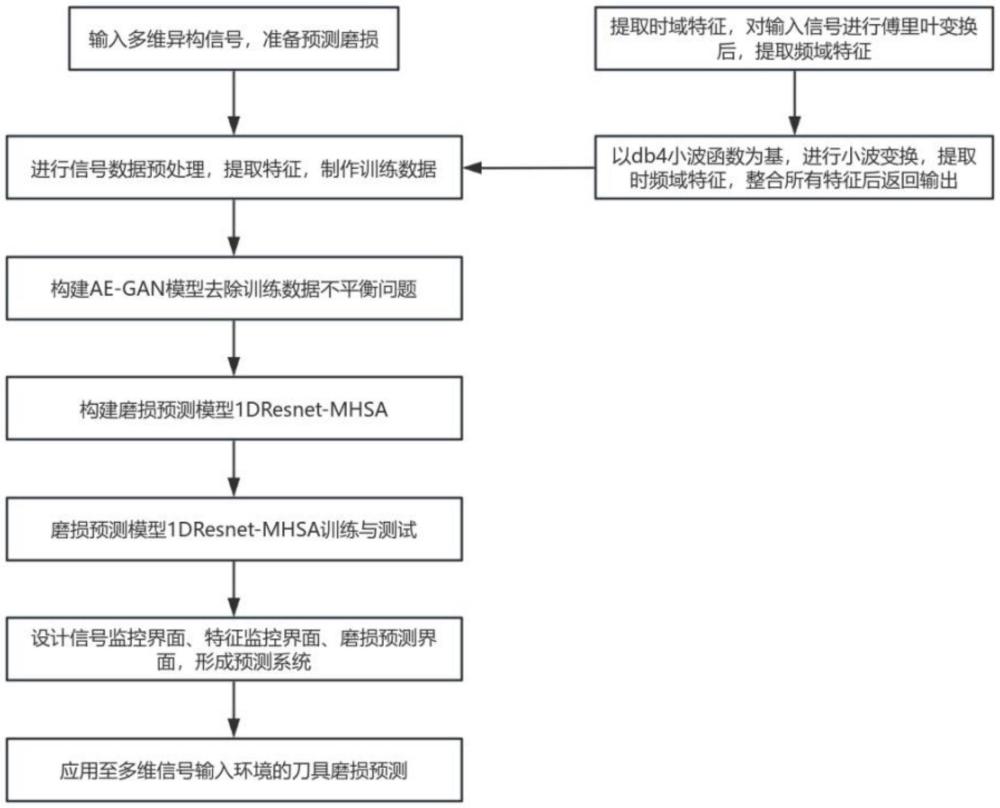

1、本發(fā)明的目的是為了解決背景技術(shù)存在的技術(shù)問題,為此,提供了基于一維殘差網(wǎng)絡(luò)的多源信號刀具磨損量預(yù)測方法及系統(tǒng),通過融合多傳感器信號并引入復(fù)雜關(guān)系處理和特征增強技術(shù),提高刀具磨損量預(yù)測的準確性和可靠性。

2、為了實現(xiàn)上述目的,本發(fā)明所采用的技術(shù)方案如下:

3、基于一維殘差網(wǎng)絡(luò)的多源信號刀具磨損量預(yù)測方法,包括:

4、步驟1:構(gòu)建信號采集模塊,將采集到的多傳感器信號轉(zhuǎn)換為頻譜圖并進行小波變換;

5、步驟2:構(gòu)建數(shù)據(jù)處理模塊,對數(shù)據(jù)進行平衡操作,解決數(shù)據(jù)不平衡,小樣本數(shù)據(jù)等問題;

6、步驟3:構(gòu)建復(fù)雜關(guān)系處理模塊,從而構(gòu)建一維殘差網(wǎng)絡(luò)結(jié)構(gòu),處理多源信號之間的復(fù)雜關(guān)系;

7、步驟4:構(gòu)建特征增強模塊,引入多頭注意力機制,增強模型的特征提取能力;

8、步驟5:構(gòu)建任務(wù)執(zhí)行模塊,使用結(jié)合一維殘差網(wǎng)絡(luò)和多頭注意力機制的模型進行刀具磨損量預(yù)測任務(wù)。

9、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟1中信號采集模塊的構(gòu)建過程包括:

10、步驟11:通過多傳感器采集信號,將音頻信息經(jīng)過濾波操作后進行快速傅里葉(fft)變換得到頻譜圖;

11、步驟12:使用db4小波函數(shù)對頻譜圖進行小波變換,使得信號在不同尺度上進行分解和分析并得到小波尺度圖;

12、其中,步驟12中小波變換包括:

13、步驟121:進行信號分解,首先將待處理的信號進行多尺度分解,信號被分解為多個不同尺度上的成分,其中低頻成分反映信號的整體趨勢,而高頻部分反映信號的細節(jié)和突變;

14、步驟122:使用小波濾波器,一個是低通濾波器,另一個是高通濾波器,兩組濾波器由db4小波函數(shù)的系數(shù)確定,低通濾波器用于提取信號的低頻成分,而高通濾波器用于提取信號的高頻成分;

15、步驟123:卷積運算,將信號與低通和高通濾波器進行卷積運算,得到低頻和高頻系數(shù),低頻系數(shù)表示信號的低頻成分,而高頻系數(shù)表示信號的高頻成分;

16、步驟124:下采樣,對卷積結(jié)果進行下采樣操作,以降低頻率,使得信號的尺度減小一半,也可以稱為子采樣;

17、步驟125:重復(fù)步驟121-125,將信號分解為更低尺度的成分,直到達到所需的分解層數(shù);在需要時,可以對分解后的信號進行重構(gòu),已恢復(fù)原始信號,這個操作通常需要用到小波系數(shù)和逆小波濾波器進行逆變換操作。

18、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟2中數(shù)據(jù)處理模塊的構(gòu)建過程包括:

19、步驟21:數(shù)據(jù)準備,確保多傳感器信號數(shù)據(jù)集包含原始數(shù)據(jù)的各種特征和分布情況;

20、步驟22:設(shè)計自編碼器,構(gòu)建自編碼器的編碼器和解碼器部分,編碼器將原始數(shù)據(jù)映射到低維表示,解碼器嘗試從低維表示中重構(gòu)原始數(shù)據(jù);

21、步驟23:構(gòu)建生成器和判別器,以適應(yīng)傳感器信號數(shù)據(jù)特點,生成器負責(zé)從隨機噪聲中生成樣本數(shù)據(jù),判別器則嘗試區(qū)分生成的假樣本和真實樣本;

22、步驟24:定義損失函數(shù),損失函數(shù)由自編碼器的重構(gòu)損失和生成對抗網(wǎng)絡(luò)的對抗損失組成,重構(gòu)損失用于衡量數(shù)據(jù)重構(gòu)的準確度,對抗損失用于促使生成器生成真實數(shù)據(jù)樣本;

23、步驟25:網(wǎng)絡(luò)訓(xùn)練,通過交替訓(xùn)練自編碼器和生成對抗網(wǎng)絡(luò)來優(yōu)化模型,先使用自編碼器的重構(gòu)損失來訓(xùn)練自編碼器,然后使用對抗損失來訓(xùn)練生成器和判別器;這個過程需要多次迭代,直到模型收斂或達到預(yù)定的訓(xùn)練輪次。

24、步驟26:對生成器生成的數(shù)據(jù)樣本進行評估,檢查其是否符合原始數(shù)據(jù)的分布特征,然后根據(jù)評估結(jié)果對模型進行優(yōu)化和調(diào)整,包括調(diào)整網(wǎng)絡(luò)結(jié)構(gòu)、損失函數(shù)和訓(xùn)練參數(shù),以改善生成結(jié)果的質(zhì)量逼真度。

25、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟22中自編碼器的構(gòu)建過程包括:

26、步驟221:定義編碼器架構(gòu),選擇一個多層感知器mlp結(jié)構(gòu),使用relu修正線性單元作為激活函數(shù),relu函數(shù)能夠在訓(xùn)練過程中幫助模型更好的收斂,同時避免梯度消失的問題。而在前向傳播的過程中,輸入信號數(shù)據(jù)經(jīng)過編碼器的各個隱藏層,并逐漸被轉(zhuǎn)換為較低維度的表示,這個過程用公式表示為:

27、h=relu(w1x+b1)

28、z=w2h+b2

29、其中,x是輸入信號數(shù)據(jù),h是隱藏層表示,z是編碼后表示,w1和w2是隱藏層和編碼層的權(quán)重矩陣,b1和b2是對應(yīng)的偏置向量;

30、步驟222:定義解碼器框架,解碼器的結(jié)構(gòu),激活函數(shù)選擇,初始化權(quán)重矩陣都與編碼器相似。在解碼器的前向傳播過程中,解碼器接收編碼器生成的表示作為輸入,嘗試將其解碼為原始的輸入數(shù)據(jù),解碼器的前向傳播過程用公式表示為:

31、h′=relu(w′1x+b′1)

32、

33、其中,h′是解碼器的隱藏層表示,是解碼器的輸出,表示重構(gòu)后的輸入數(shù)據(jù);

34、步驟223:定義損失函數(shù)和優(yōu)化器,自動編碼器的目標是最小化輸入數(shù)據(jù)與解碼器輸出數(shù)據(jù)之間的重構(gòu)誤差,使用均方誤差mse作為損失函數(shù),mse通過以下公式定義:

35、

36、其中,n是樣本數(shù)量,xi是原始輸入數(shù)據(jù),是解碼器的輸出數(shù)據(jù);

37、步驟224:反向傳播和參數(shù)更新,通過反向傳播計算損失相對于參數(shù)的梯度,并使用梯度下降優(yōu)化算法更新參數(shù)。

38、步驟23中生成器和判別器的構(gòu)建過程包括:

39、步驟231:gan由生成器和判別器兩部分組成,生成器接收一個隨機噪聲向量z,輸出生成的數(shù)據(jù)樣本g(z;θg):

40、

41、其中g(shù)是生成器的函數(shù),參數(shù)為θg,用于將隨機噪聲z映射維生成的數(shù)據(jù)樣本判別器接收真實數(shù)據(jù)樣本x或生成的數(shù)據(jù)樣本通過參數(shù)θdisc輸出該樣本為真實數(shù)據(jù)的概率d(x;θdisc)和其中d是判別器的函數(shù),參數(shù)為θdisc;

42、步驟232:判別器和生成器的損失函數(shù)定義,判別器的目標是最大化對數(shù)似然估計,使得真實樣本的概率接近1,生成樣本的概率接近0:

43、

44、生成器的目標是最小化對數(shù)似然估計,使得生成樣本的概率接近1,最大化生成樣本被判別器認為真實樣本的概率:

45、

46、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟24中網(wǎng)絡(luò)訓(xùn)練和定義損失函數(shù)的構(gòu)建過程包括:

47、步驟241:初始化,隨機初始化編碼器、解碼器的參數(shù)θe、θd,生成器和判別器的參數(shù)θg、θdisc;

48、步驟242:自編碼器的前向傳播和重建損失計算,編碼器將輸入數(shù)據(jù)x映射再潛在空間表示z:

49、z=e(x;θe)

50、解碼器將潛在空間表示z重建為輸入數(shù)據(jù)

51、

52、計算重建損失lrecon:

53、

54、步驟243:gan的前向前向傳播和對抗損失計算,計算判別器損失ld:

55、

56、計算生成器損失lg:

57、

58、步驟244:反向傳播和參數(shù)更新,更新編碼器和解碼器參數(shù),最小化重建損失:

59、

60、

61、更新判別器參數(shù),最小化判別器損失:

62、

63、更新生成器參數(shù),最小化生成器損失:

64、

65、步驟245:迭代訓(xùn)練,重復(fù)步驟241-245,知道模型收斂,每次迭代包含一次編碼器和解碼器的更新,以及一次生成器和判別器的更新。

66、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟3中復(fù)雜關(guān)系處理模塊的構(gòu)建過程包括:

67、步驟31:從多傳感器收集車床信號數(shù)據(jù),使用濾波器對信號特征提取和分類;

68、步驟32:將處理后的時域信號通過傅里葉變換轉(zhuǎn)換為頻域信號,并進一步通過小波變換提取多尺度特征;

69、步驟33:構(gòu)建一維殘差網(wǎng)絡(luò)(1d?resnet),以捕捉和處理多源信號之間的復(fù)雜關(guān)系,殘差網(wǎng)絡(luò)通過引入跳躍連接,使深層網(wǎng)絡(luò)的訓(xùn)練更加穩(wěn)定,并能有效整合和提取多源信號的關(guān)聯(lián)特征;

70、在步驟31中使用濾波器對信號特征提取和分類過程中,包括:

71、步驟311:信號預(yù)處理,通過預(yù)處理步驟去除噪聲并突出信號的主要特征。使用低通濾波器去除高頻噪聲:

72、

73、然后對信號進行歸一化處理,將它們的幅度控制在一個標準范圍內(nèi):

74、

75、其中,μ和σ分別為信號的均值和標準差。

76、步驟312:從信號中提取時域特征,通過這些特征反映信號的統(tǒng)計性質(zhì),時域特征包括:最大值、最小值、峰峰值、平均值、方差、標準差、均方值、峭度、偏度、波形因子、峰值因子、脈沖因子、裕度因子、余隙因子;

77、最大值:數(shù)據(jù)集中的最大值,表示數(shù)據(jù)中的最大觀測值。

78、maximum=max(x1,x2,...,xn)

79、最小值:數(shù)據(jù)集中的最小值,表示數(shù)據(jù)中的最小觀測值。

80、minimum=min(x1,x2,...,xn)

81、峰峰值:峰峰值是最大值和最小值之間的差異,表示了數(shù)據(jù)的范圍。

82、peak-to-peak=max(x1,x2,...,xn)-min(x1,x2,...,xn)

83、平均值:平均值是數(shù)據(jù)集中所有觀測值的算術(shù)平均值,用來表示數(shù)據(jù)的集中趨勢。

84、

85、方差:方差是觀測值與平均值之間差異的平方的平均值。它表示數(shù)據(jù)的離散程度或分散程度。

86、

87、標準差:標準差是方差的平方根。它衡量數(shù)據(jù)的離散度,以與平均值的單位相對應(yīng)。

88、

89、均方值:均方值是數(shù)據(jù)集中所有觀測值的平方的平均值,然后再開平方。它通常用于表示信號或波形的均方根大小,類似于均方根值。

90、

91、峭度:峭度用于描述數(shù)據(jù)分布的尾部和峰度。正峭度表示數(shù)據(jù)分布尾部較重,有更多的極端值,而負峭度表示數(shù)據(jù)分布尾部較輕,更多數(shù)據(jù)集中在均值附近。

92、kurtosis=(1/n)*∑((xi-mean)/standard?deviation)^4-3

93、偏度:偏度用于描述數(shù)據(jù)分布的不對稱性。正偏度表示數(shù)據(jù)分布向右傾斜,負偏度表示數(shù)據(jù)分布向左傾斜,零偏度表示數(shù)據(jù)分布對稱。

94、skewness=(1/n)*∑((xi-mean)/standard?deviation)^3

95、波形因子:波形因子用于衡量信號波形的峰值與均方根值之間的關(guān)系。它通常用于分析信號的峰值性質(zhì),較大的波形因子表示信號有更尖銳的峰值。

96、crest?factor=peak?value/rms?value

97、峰值因子:峰值因子也用于衡量信號波形的峰值與均方根值之間的關(guān)系。較大的峰值因子表示信號具有更大的峰值。

98、peak?factor=peak?value/rms?value

99、脈沖因子:脈沖因子用于描述信號的脈沖性質(zhì),即信號的短期峰值與均方根值之間的關(guān)系。它通常用于分析瞬態(tài)信號,較大的脈沖因子表示信號包含更多的瞬態(tài)峰值

100、pulse?factor=peak?value/rms?value

101、裕度因子:裕度因子用于描述信號的峰值與均值之間的關(guān)系。它通常用于分析信號的裕度,較大的裕度因子表示信號具有更大的峰值相對于均值。

102、crest?factor=peak?value/mean?value余隙因子:余隙因子用于描述信號峰值與信號范圍之間的關(guān)系。它通常用于分析信號的動態(tài)范圍,較大的余隙因子表示信號具有更大的峰值相對于其范圍。

103、margin?factor=peak?value/range

104、在步驟32中時域信號通過傅里葉變換轉(zhuǎn)換為頻域信號的過程中,包括:

105、步驟321:通過傅里葉變換將時間序列信號轉(zhuǎn)換到頻域,提取頻域特征,涉及頻域特征提取公式如下:

106、傅里葉變換:通過傅里葉變換將時域信號轉(zhuǎn)換為頻域信號。

107、

108、頻譜能量:表示信號在不同頻段上的能量分布。

109、

110、中心頻率:表示頻譜的重心。

111、

112、頻譜熵:表示頻譜的復(fù)雜度。

113、

114、其中,

115、步驟322:時頻域特征提取,結(jié)合時域和頻域,通過小波變換將信號分解成不同的頻帶能量,提取局部特征;

116、

117、步驟323:將提取到的所有特征組合為一個特征向量。

118、在步驟33中一維殘差網(wǎng)絡(luò)的構(gòu)建過程中,包括:

119、步驟331:輸入數(shù)據(jù)準備,將預(yù)處理后的多傳感器信號數(shù)據(jù)(切削力信號、振動信號和聲發(fā)射信號等)作為網(wǎng)絡(luò)的輸入。假設(shè)輸入信號為

120、x∈rn×d

121、其中n是時間步長,d是信號的維度。這個步驟的作用是確保模型能夠接收到經(jīng)過處理的高質(zhì)量數(shù)據(jù),準備進行后續(xù)的特征提取和分析。

122、步驟332:構(gòu)建初始卷積層,對輸入信號進行初始卷積,以提取低級特征,卷積操作捕捉局部時序模式和頻率特征。具體公式為:

123、xconv1=conv1d(x,w1,b1)

124、其中,conv1d表示一維卷積操作,w1和b1分別是卷積核權(quán)重和偏置。初始卷積層的作用是降低輸入信號的復(fù)雜性,提取出初步的局部特征,為后續(xù)的深層特征提取打下基礎(chǔ)。

125、步驟333:殘差塊的構(gòu)建,殘差塊是resnet的核心部分,每個殘差塊包括兩個卷積層和一個快捷連接。這種結(jié)構(gòu)允許信號通過跳躍連接直接傳遞,從而減輕梯度消失問題,促進深層網(wǎng)絡(luò)的訓(xùn)練。

126、1)殘差塊的第一個卷積層:

127、xconv2=relu(batchnorm(conv1d(xconv1,w2,b2)))

128、其中,batchnorm表示批歸一化操作,relu是激活函數(shù)。這個卷積層的作用是進一步提取信號中的特征,并通過批歸一化穩(wěn)定訓(xùn)練過程。

129、2)殘差塊第二個卷積層:

130、xconv3=batchnorm(conv1d(xconv2,w3,b3))第二個卷積層進一步處理已經(jīng)提取的特征,并通過批歸一化維持信號的穩(wěn)定性。

131、3)快捷連接:

132、xres=xconv1+xconv3

133、如果輸入和輸出的維度不一致,則需要進行線性變換匹配維度:

134、xres=xconv1+conv1d(xconv1,wskip,bskip)

135、快捷連接的作用是直接將輸入信號加到輸出上,確保信息的直接傳遞,減少梯度消失,提升模型的訓(xùn)練效果。

136、4)激活輸出:

137、xout=relu(xres)

138、通過relu激活函數(shù),將非線性引入到模型中,提高模型的表達能力。

139、重復(fù)多個殘差塊,構(gòu)建深層網(wǎng)絡(luò)。這些殘差塊的作用是逐層提取和整合特征,捕捉信號中的復(fù)雜模式和關(guān)系。

140、步驟334:全局平均池化層,通過全局平均池化層減少特征維度,聚合信息;具體公式為:

141、

142、全局平均池化層的作用是將所有時間步的特征取平均,生成一個固定大小的特征向量,減少維度的同時保留重要信息。

143、步驟335:構(gòu)建全連接層和輸出層,將全局平均池化的結(jié)果輸入全連接層,得到最終的輸出。具體公式為:

144、xfc=relu(wfcxgap+bfc)

145、ypred=softmax(woutxfc+bout)

146、其中,wfc和bfc是全連接層的權(quán)重和偏置,wout和bout是輸出層的權(quán)重和偏置。全連接層的作用是將池化后的特征進行非線性變換,輸出層則通過softmax函數(shù)進行分類,生成最終的預(yù)測結(jié)果。

147、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟4中特征增強模塊的構(gòu)建過程包括:

148、步驟41:預(yù)處理信號,對多傳感器采集的信號進行標準化和歸一化處理,確保信號的各個維度在相同的尺度上,有助于模型更好地處理輸入數(shù)據(jù);

149、步驟42:線性變換,將預(yù)處理后的信號輸入到線性層,生成query、key和value矩陣;

150、q=xwq,k=xwk,v=xwv

151、其中,x是輸入信號矩陣;wq,wk,wv是可學(xué)習(xí)的權(quán)重矩陣;q,k,v分別是查詢、鍵和值矩陣。

152、步驟43:計算注意力分數(shù),通過點積計算查詢和鍵之間的注意力分數(shù):

153、

154、其中,dk是鍵的維度,用于縮放點積結(jié)果。

155、縮放及歸一化后進行加權(quán)求和,對注意力分數(shù)進行縮放和softmax歸一化,以確保分數(shù)的穩(wěn)定性和可解釋性,使用歸一化后的注意力權(quán)重對值進行加權(quán)求和,得到每個注意力頭的輸出:

156、

157、其中,h是注意力頭的數(shù)量。qi,ki,vi是第i個頭的查詢、鍵和值矩陣。

158、步驟44:拼接注意力頭的輸出后進行殘差連接和層歸一化。將所有注意力頭的輸出拼接起來,并進行線性變換以生成最終的輸出特征表示:

159、multihead(q,k,v)=concat(head1,...,headh)wo

160、其中:headi=attention(qi,ki,vi),wo是輸出的權(quán)重矩陣。

161、然后將多頭注意力機制的輸出和輸入特征進行殘差連接,并進行層歸一化:

162、y=layernorm(x+multihead(q,k,v))。

163、以下為本發(fā)明中方法進一步限定的技術(shù)方案,步驟5中任務(wù)執(zhí)行模塊的構(gòu)建過程包括:

164、步驟51:結(jié)合一維殘差網(wǎng)絡(luò)和多頭注意力機制;

165、步驟52:定義模型的損失函數(shù),使用優(yōu)化算法最小化損失函數(shù),然后迭代訓(xùn)練模型直到收斂;

166、在步驟51結(jié)合一維殘差網(wǎng)絡(luò)和多頭注意力機制的過程中,包括:

167、步驟511:一維殘差網(wǎng)絡(luò)部分由多個殘差快深度堆疊,形成深層的一維殘差網(wǎng)絡(luò)以增強模型對復(fù)雜信號的建模能力,殘差快是網(wǎng)絡(luò)的基本構(gòu)建,每個殘差快包含兩個或多個一維卷積層,每個卷積層后結(jié)relu激活函數(shù)和批量歸一化,在輸入和輸出之間引入跳躍連接;

168、y=f(x,{wi})+x

169、其中,f(x,{wi})表示殘差塊中的卷積和激活操作,x是輸入,y是輸出。在一維卷積層中,多傳感器信號經(jīng)過預(yù)處理操作后進入進行特征提取。

170、步驟512:將一維殘差網(wǎng)絡(luò)(1dresnet)的輸出特征輸入到多頭注意力機制中,通過注意力機制增強特征表示。將注意力機制輸出的特征進行殘差連接和層歸一化,形成最終特征表示:

171、y=layernorm(x+mulitihead(q,k,v))以下為本發(fā)明中方法進一步限定的技術(shù)方案,在步驟52中,包括:

172、步驟521:定義損失函數(shù),使用均方誤差作為損失函數(shù),用于衡量模型預(yù)測值與實際值之間的差異:

173、

174、mse對大誤差較為敏感,能有效懲罰大偏差的預(yù)測結(jié)果,有助于提高模型的準確性。

175、步驟522:優(yōu)化算法設(shè)計,使用adam優(yōu)化器,這是一個結(jié)合了動量和rmsprop的優(yōu)化算法,能夠自適應(yīng)調(diào)整每個參數(shù)的學(xué)習(xí)率,適用于處理稀疏梯度和高維數(shù)據(jù):

176、mt=β1mt-1+(1-β1)gt

177、vt=β2vt-1+(1-β2)g2t

178、

179、其中,mt是一階矩估計,vt是二階矩估計,β1,β2是動量項的指數(shù)衰減率,gt是梯度,α是學(xué)習(xí)率,θt是模型參數(shù)。adam優(yōu)化器結(jié)合了動量和rmsprop的優(yōu)點,能夠自適應(yīng)調(diào)整學(xué)習(xí)率,在處理稀疏梯度和高維數(shù)據(jù)時表現(xiàn)優(yōu)越,并且能夠快速收斂到最優(yōu)解。

180、基于一維殘差網(wǎng)絡(luò)的多源信號刀具磨損量預(yù)測系統(tǒng),用于實現(xiàn)上述的基于一維殘差網(wǎng)絡(luò)的多源信號刀具磨損量預(yù)測方法,包括:

181、信號采集模塊,用于將采集到的多傳感器信號轉(zhuǎn)換為頻譜圖并進行小波變換;

182、數(shù)據(jù)處理模塊,用于對數(shù)據(jù)進行平衡操作;

183、復(fù)雜關(guān)系處理模塊,用于構(gòu)建一維殘差網(wǎng)絡(luò)結(jié)構(gòu),處理多源信號之間的復(fù)雜關(guān)系;

184、特征增強模塊,用于引入多頭注意力機制,增強模型的特征提取能力;

185、任務(wù)執(zhí)行模塊,使用結(jié)合一維殘差網(wǎng)絡(luò)和多頭注意力機制的模型進行刀具磨損量預(yù)測任務(wù)。

186、相對于現(xiàn)有技術(shù),本發(fā)明具有如下技術(shù)效果:

187、本發(fā)明實現(xiàn)了從信號采集到刀具磨損量預(yù)測的全流程監(jiān)測;設(shè)置了信號采集模塊,通過多傳感器信號轉(zhuǎn)換和小波變換,提高信號分析的精度;設(shè)置了數(shù)據(jù)處理模塊,通過數(shù)據(jù)平衡操作,解決數(shù)據(jù)不平衡和小樣本問題,提高數(shù)據(jù)處理的有效性;設(shè)置了復(fù)雜關(guān)系處理模塊,通過構(gòu)建一維殘差網(wǎng)絡(luò),處理多源信號之間的復(fù)雜關(guān)系,實現(xiàn)全面的信號分析;設(shè)置了特征增強模塊,通過引入多頭注意力機制,增強特征提取能力,提高刀具磨損量預(yù)測的準確性;設(shè)置了任務(wù)執(zhí)行模塊,通過結(jié)合一維殘差網(wǎng)絡(luò)和多頭注意力機制的模型,進行刀具磨損量預(yù)測,提高故障檢測的細化分析能力。

188、下面結(jié)合附圖與實施例,對本發(fā)明進一步說明。

- 還沒有人留言評論。精彩留言會獲得點贊!