多任務場景下人手動作重定向至異構機器手的方法及裝置與流程

本發明涉及機器人技術與智能控制,特別是指一種多任務場景下人手動作重定向至異構機器手的方法及裝置。

背景技術:

1、動作重定向技術不僅能夠將人類手部的復雜運動映射到機器人手部,實現高效和精準的動作遷移,而且在數據采集和遙控操作控制中展現出獨特優勢。采用動作重定向技術,可以在采集自然動作的真實數據中構建大規模訓練數據集,同時也能使遠程操控的操作員借助手部動作進行實時操作。靈巧手作為機器人系統的重要組成部分,其高自由度和靈活性在精細操作、復雜環境交互以及多任務場景中發揮著舉足輕重的作用,為各領域實際應用提供了關鍵支持。

2、然而,人類手部與機器手之間存在明顯的物理和運動學差異。人類手部擁有27個自由度,而不同機器手在設計時其自由度和關節限制及物理尺寸均存在巨大差別。這種結構和能力上的不匹配使得直接映射人手動作變得困難,即使在多樣化任務環境中也可能導致動作失真或根本無法實現預期效果。許多傳統方法依賴于人工設定的規則或固定映射方案,其在處理異構機器人系統時表現出顯著局限性,往往缺乏必要的自適應能力,難以兼顧不同任務場景下對精細操作與粗粒度操作的平衡需求。為了彌補上述的不足問題,目前一方面采用無監督神經網絡,通過能量函數將人手關鍵點的功能向量映射至機器人手的關節角度,從而嘗試捕捉人手動作中隱含的非線性關系。另一方面通過基于規則的運動學映射方法,采用中間關節旋轉來重構人手的姿勢,從而在一定程度上實現手指角度的映射。此外,還有一種方法則借助指尖向量的優化技術,通過調整優化策略以平衡功能性、約束條件及運動平滑性,但上述方法在面對不同復雜場景時,不能高效地分配手指間的優化權重,不能滿足復雜任務場景下的實時動態適應性的要求。

技術實現思路

1、為了解決現有技術存在的現有的重定向技術面對不同復雜場景式,不能高效地分配手指間的優化權重,導致不能滿足任務場景下對實時動態適用性的要求的技術問題,本發明實施例提供了一種多任務場景下人手動作重定向至異構機器手的方法及裝置。所述技術方案如下:

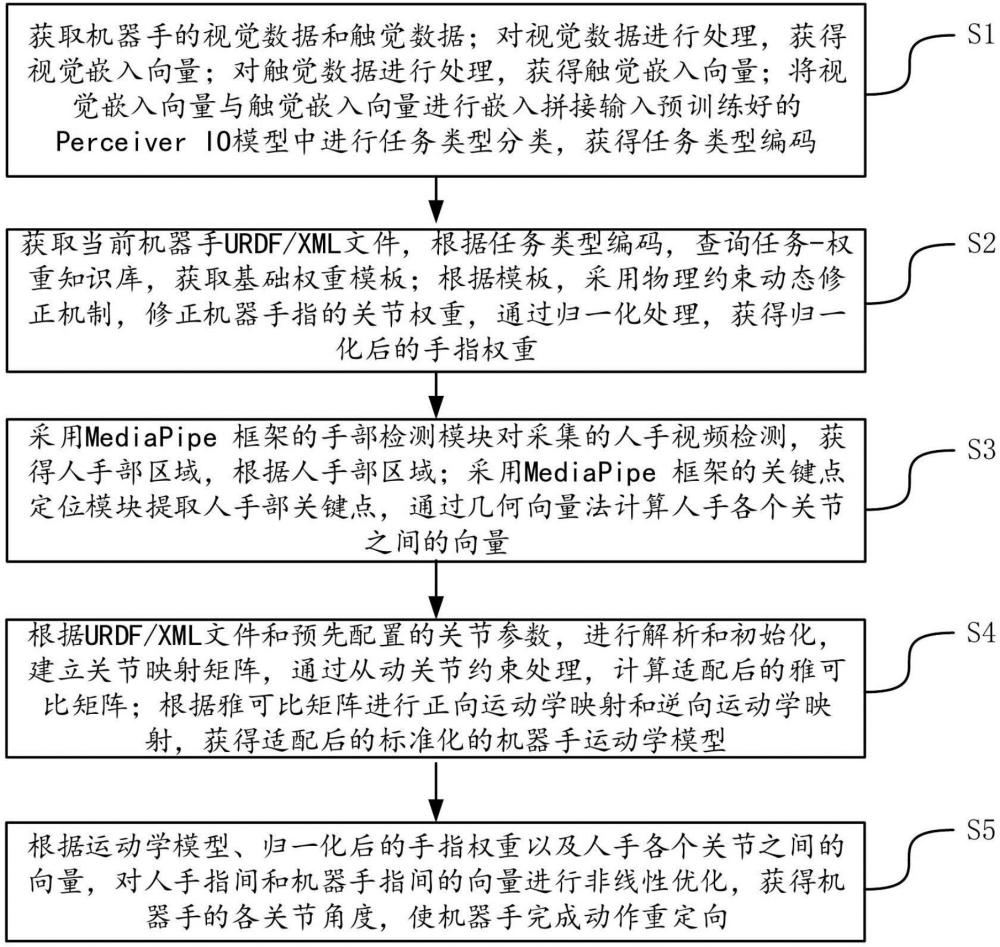

2、一方面,提供了一種多任務場景下人手動作重定向至異構機器手的方法,該方法由多任務場景下人手動作重定向至異構機器手的設備實現,該方法包括:

3、s1、獲取機器手的視覺數據和觸覺數據;對視覺數據進行處理,獲得視覺嵌入向量;對觸覺數據進行處理,獲得觸覺嵌入向量;將視覺嵌入向量與觸覺嵌入向量進行嵌入拼接輸入預訓練好的perceiver?io模型中進行任務類型分類,獲得任務類型編碼;

4、s2、獲取當前機器手urdf/xml文件,根據任務類型編碼,查詢任務-權重知識庫,獲取基礎權重模板;根據所述模板,采用物理約束動態修正機制,修正機器手指的關節權重,通過歸一化處理,獲得歸一化后的手指權重;

5、s3、采用mediapipe?框架的手部檢測模塊對采集的人手視頻檢測,獲得人手部區域,根據人手部區域;采用mediapipe?框架的關鍵點定位模塊提取人手部關鍵點,通過幾何向量法計算人手各個關節之間的向量;

6、s4、根據所述urdf/xml文件和預先配置的關節參數,進行解析和初始化,建立關節映射矩陣,通過從動關節約束處理,計算適配后的雅可比矩陣;根據所述雅可比矩陣進行正向運動學映射和逆向運動學映射,獲得適配后的標準化的機器手運動學模型;

7、s5、根據所述運動學模型、歸一化后的手指權重以及人手各個關節之間的向量,對人手指間和機器手指間的向量進行非線性優化,獲得機器手的各關節角度,使機器手完成動作重定向。

8、可選地,所述s1的將視覺嵌入向量與觸覺嵌入向量進行嵌入拼接輸入預訓練好的perceiver?io模型中進行任務類型分類,獲得任務類型編碼,包括:

9、s11、將視覺嵌入向量與觸覺嵌入向量進行嵌入拼接輸入預訓練好的perceiverio模型中,通過自注意力機制和跨模態查詢機制進行特征融合,獲得融合后的多模態特征;

10、s12、融合后的多模態特征輸入perceiver?io模型的transformer?編碼器層進行深層語義表征,獲得深層特征;

11、s13、深層特征輸入全連接分類層中映射至任務類別,通過softmax?激活函數進行計算獲得任務類型編碼。

12、可選地,所述修正機器手指的關節權重的過程通過下述公式(1)表示:

13、(1)

14、其中,表示動態修正權重;表示第i個手指的基礎權重;表示第i指關節最大扭矩;表示系統全局安全扭矩閾值;表示第i指關節角度最大限位;表示第i指關節角度最小限位;表示人手第i指自然運動范圍;表示扭矩約束修正項;表示運動空間約束修正項。

15、可選地,所述s4的根據所述urdf/xml文件和預先配置的關節參數,進行解析和初始化,建立關節映射矩陣,通過從動關節約束處理,包括:

16、s41、采用yourdfpy工具包解析urdf/xml文件,提取機器人結構和參數;

17、s42、根據預先配置的關節參數對機器人結構和參數進行校正和信息補充處理,獲得處理后的機器人結構和參數;

18、s43、根據處理后的機器人結構和參數,建立關節映射矩陣;

19、s44、根據關節映射矩陣,計算從動關節位置完成從動關節約束處理;其中,從動關節位置的計算公式通過下述公式(2)表示:

20、(2)

21、其中,表示從動關節位置向量;表示主動關節位置向量;表示傳動比向量;表示位置偏置向量;表示向量逐元素乘法。

22、可選地,所述計算適配后的雅可比矩陣的過程通過下述公式(3)表示:

23、(3)

24、其中,表示適配后的雅可比矩陣;表示目標關節雅可比矩陣;表示第i個從動關節的雅可比矩陣;表示第i個從動關節的傳動比。

25、可選地,所述正向運動學映射的計算公式通過下述公式(4)表示:

26、(4)

27、其中,x表示笛卡爾坐標下的手指坐標;f表示正運動學函數;

28、其中,所述逆向運動學映射的計算公式通過下述公式(5)表示:

29、(5)

30、其中,表示逆運動學映射函數。

31、可選地,所述s5的對人手指間和機器手指間的向量進行非線性優化的問題通過下述公式(6)表示:

32、(6)

33、

34、其中,表示第i個手指的基礎權重;表示正則項系數;表示手指關節角度;表示機器手第i指的正運動學函數,輸出末端位置坐標;表示人手第i指末端的3d坐標;表示機器人的安全默認關節,半張開狀態;表示手指關節的最小關節;表示手指關節的最大關節;表示關節扭矩向量,通過雅可比矩陣和接觸力計算獲得;布爾函數,檢測機器手位姿是否與環境無碰撞。

35、另一方面,提供了一種多任務場景下人手動作重定向至異構機器手的裝置,該裝置應用于多任務場景下人手動作重定向至異構機器手的方法,該裝置包括:

36、任務類型分配單元,用于獲取機器手的視覺數據和觸覺數據;對視覺數據進行處理,獲得視覺嵌入向量;對觸覺數據進行處理,獲得觸覺嵌入向量;將視覺嵌入向量與觸覺嵌入向量進行嵌入拼接輸入預訓練好的perceiver?io模型中進行任務類型分類,獲得任務類型編碼;

37、動態權重修正單元,用于獲取當前機器手urdf/xml文件,根據任務類型編碼,查詢任務-權重知識庫,獲取基礎權重模板;根據所述模板,采用物理約束動態修正機制,修正機器手指的關節權重,通過歸一化處理,獲得歸一化后的手指權重;

38、人手關鍵點識別單元,用于采用mediapipe?框架的手部檢測模塊對采集的人手視頻檢測,獲得人手部區域,根據人手部區域;采用mediapipe?框架的關鍵點定位模塊提取人手部關鍵點,通過幾何向量法計算人手各個關節之間的向量;

39、計算與獲取單元,用于根據所述urdf/xml文件和預先配置的關節參數,進行解析和初始化,建立關節映射矩陣,通過從動關節約束處理,計算適配后的雅可比矩陣;根據所述雅可比矩陣進行正向運動學映射和逆向運動學映射,獲得適配后的標準化的機器手運動學模型;

40、優化單元,用于根據所述運動學模型、歸一化后的手指權重以及人手各個關節之間的向量,對人手指間和機器手指間的向量進行非線性優化,獲得機器手的各關節角度,使機器手完成動作重定向。

41、可選地,所述任務類型分配單元,用于:

42、將視覺嵌入向量與觸覺嵌入向量進行嵌入拼接輸入預訓練好的perceiver?io模型中,通過自注意力機制和跨模態查詢機制進行特征融合,獲得融合后的多模態特征;

43、融合后的多模態特征輸入perceiver?io模型的transformer?編碼器層進行深層語義表征,獲得深層特征;

44、深層特征輸入全連接分類層中映射至任務類別,通過softmax?激活函數進行計算獲得任務類型編碼。

45、可選地,所述修正機器手指的關節權重的過程通過下述公式(1)表示:

46、(1)

47、其中,表示動態修正權重;表示第i個手指的基礎權重;表示第i指關節最大扭矩;表示系統全局安全扭矩閾值;表示第i指關節角度最大限位;表示第i指關節角度最小限位;表示人手第i指自然運動范圍;表示扭矩約束修正項;表示運動空間約束修正項。

48、可選地,所述計算與獲取單元,用于:

49、采用yourdfpy工具包解析urdf/xml文件,提取機器人結構和參數;

50、根據預先配置的關節參數對機器人結構和參數進行校正和信息補充處理,獲得處理后的機器人結構和參數;

51、根據處理后的機器人結構和參數,建立關節映射矩陣;

52、根據關節映射矩陣,計算從動關節位置完成從動關節約束處理;其中,從動關節位置的計算公式通過下述公式(2)表示:

53、(2)

54、其中,表示從動關節位置向量;表示主動關節位置向量;表示傳動比向量;表示位置偏置向量;表示向量逐元素乘法。

55、可選地,所述計算適配后的雅可比矩陣的過程通過下述公式(3)表示:

56、(3)

57、其中,表示適配后的雅可比矩陣;表示目標關節雅可比矩陣;表示第i個從動關節的雅可比矩陣;表示第i個從動關節的傳動比。

58、可選地,所述正向運動學映射的計算公式通過下述公式(4)表示:

59、(4)

60、其中,x表示笛卡爾坐標下的手指坐標;f表示正運動學函數;

61、其中,所述逆向運動學映射的計算公式通過下述公式(5)表示:

62、(5)

63、其中,表示逆運動學映射函數。

64、可選地,所述對人手指間和機器手指間的向量進行非線性優化的問題通過下述公式(6)表示:

65、(6)

66、

67、其中,表示第i個手指的基礎權重;表示正則項系數;表示手指關節角度;表示機器手第i指的正運動學函數,輸出末端位置坐標;表示人手第i指末端的3d坐標;表示機器人的安全默認關節,半張開狀態;表示手指關節的最小關節;表示手指關節的最大關節;表示關節扭矩向量,通過雅可比矩陣和接觸力計算獲得;布爾函數,檢測機器手位姿是否與環境無碰撞。

68、另一方面,提供一種多任務場景下人手動作重定向至異構機器手的設備,所述多任務場景下人手動作重定向至異構機器手的設備包括:處理器;存儲器,所述存儲器上存儲有計算機可讀指令,所述計算機可讀指令被所述處理器執行時,實現如上述多任務場景下人手動作重定向至異構機器手的方法中的任一項方法。

69、另一方面,提供了一種計算機可讀存儲介質,所述存儲介質中存儲有至少一條指令,所述至少一條指令由處理器加載并執行以實現上述多任務場景下人手動作重定向至異構機器手的方法中的任一項方法。

70、本發明實施例提供的技術方案帶來的有益效果至少包括:

71、本發明實施例首先獲取機器手的視覺數據和觸覺數據;對視覺數據進行處理,獲得視覺嵌入向量;對觸覺數據進行處理,獲得觸覺嵌入向量;將視覺嵌入向量與觸覺嵌入向量進行嵌入拼接輸入預訓練好的perceiver?io模型中進行任務類型分類,獲得任務類型編碼;獲取當前機器手urdf/xml文件,根據任務類型編碼,查詢任務-權重知識庫,獲取基礎權重模板;其次,根據模板,采用物理約束動態修正機制,修正機器手指的關節權重,通過歸一化處理,獲得歸一化后的手指權重;采用mediapipe?框架的手部檢測模塊對采集的人手視頻檢測,獲得人手部區域,根據人手部區域;采用mediapipe?框架的關鍵點定位模塊提取人手部關鍵點,通過幾何向量法計算人手各個關節之間的向量;

72、根據urdf/xml文件和預先配置的關節參數,進行解析和初始化,建立關節映射矩陣,通過從動關節約束處理,計算適配后的雅可比矩陣;根據雅可比矩陣進行正向運動學映射和逆向運動學映射,獲得適配后的標準化的機器手運動學模型;最后,根據運動學模型、歸一化后的手指權重以及人手各個關節之間的向量,對人手指間和機器手指間的向量進行非線性優化,獲得機器手的各關節角度,使機器手完成動作重定向。

73、本發明實施例通過構建任務-權重動態耦合機制與增量式語義知識庫,解決了傳統方案對特定任務與機型的過度依賴問題;本發明在抓握、提拉以及精密裝配的混合任務場景中,無需人工調整權重參數。采用本發明可提升跨任務與異構機型的泛化能力,可支持支持從2自由度夾爪到21自由度仿生手的零樣本適配。

- 還沒有人留言評論。精彩留言會獲得點贊!